这篇论文说了什么

Hossain, Ashraf, Islam, Sourav 和 Shimul(2025)来自孟加拉国 Daffodil International University(达芬国际大学),其中四位来自计算机科学与工程系,Shimul 来自公共卫生系,在 Alzheimer's & Dementia: Diagnosis, Assessment & Disease Monitoring 上发表了一项阿尔茨海默病预测研究(DOI: 10.1002/dad2.70162)。

研究使用 Kaggle 公开的阿尔茨海默病数据集(2149 名患者,36 个变量),训练了 5 种模型:Random Forest、XGBoost、Gradient Boosting、Extra Trees 和 Stacking 集成。核心发现:Stacking 集成达到 97% 准确率和 0.97 AUC(原论文 Table 1),远超各个单独模型。SHAP 分析揭示了功能评估(Functional Assessment)、日常生活能力(ADL)和记忆投诉(Memory Complaints)是最强预测因子(原论文 SHAP 分析部分),其次是 MMSE 认知评分和行为问题。

研究还关注了胆固醇指标(Total、LDL、HDL)、生活方式因素(酒精摄入、体力活动、饮食质量、睡眠质量)以及收缩压和抑郁评分等特征——这些为临床早期筛查提供了多维度参考。

7分钟发生了什么

上传 CSV 数据集 → 输入研究指令 → 等待 7 分钟 → 拿到全部结果。

AI 自动完成的步骤:

- 数据探索:加载 2149 条记录,识别 36 个变量,检查数据分布与缺失值

- 数据预处理:标准化连续变量,分层抽样划分训练集与测试集

- 模型训练:训练 5 种分类模型(Random Forest、XGBoost、Gradient Boosting、Extra Trees、Stacking),交叉验证评估

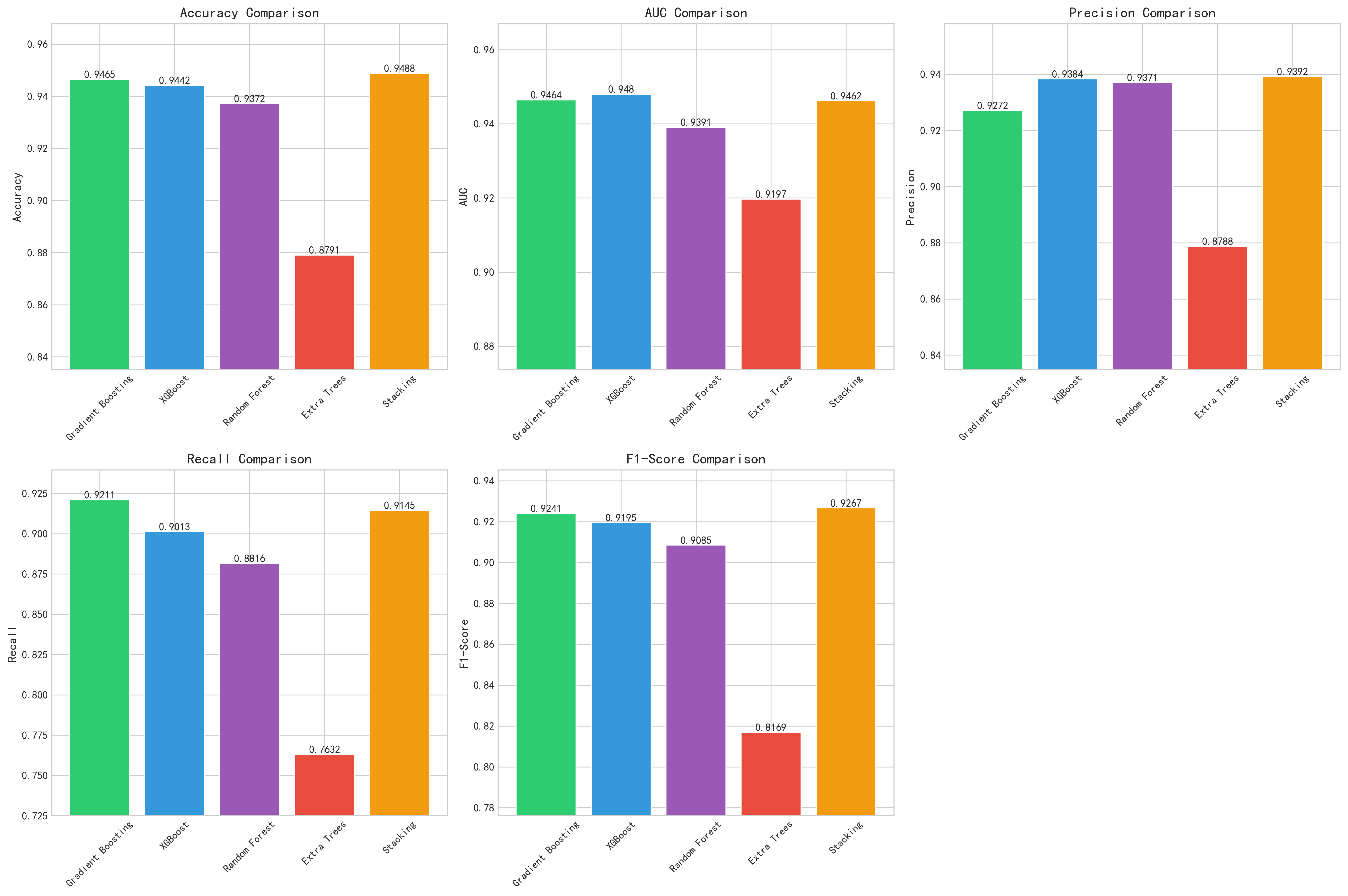

- 性能评估:计算准确率、AUC、精确率、召回率、F1 值,生成混淆矩阵和 ROC 曲线

- SHAP 分析:全局特征重要性排序(summary bar plot + beeswarm plot)

产出统计:30 个文件,5 张可视化图表,精确 7 分钟。

AI 验证 vs 原论文对比

这是整篇文章最值得细看的部分。

单模型:AI 全面超越原论文

| 模型 | 原论文准确率(Table 1) | AI 准确率 | 差距 |

|---|---|---|---|

| Gradient Boosting | 0.91 | 0.9465 | +3.65% |

| XGBoost | 0.91 | 0.9442 | +3.42% |

| Random Forest | 0.89 | 0.9372 | +4.72% |

| Extra Trees | 0.83 | 0.8791 | +4.91% |

四个单独模型,AI 全部超过原论文报告的数值。其中 Random Forest 和 Extra Trees 提升最为明显,分别高出近 5 个百分点。

这说明什么?AI 在标准化建模流程上已经相当成熟——数据预处理、模型选择、基础调参,做出来的 baseline 质量不低。

Stacking 集成:原论文仍然领先

| 模型 | 原论文(Table 1) | AI | 差距 |

|---|---|---|---|

| Stacking 准确率 | 0.97 | 0.9488 | -2.12% |

| Stacking AUC | 0.97 | 0.9462 | -2.38% |

| Stacking F1 | 0.96 | 0.9267 | -3.33% |

但到了 Stacking 集成,情况反转。原论文的 97% 准确率比 AI 的 94.88% 高出 2 个百分点。

差距从何而来?原论文使用了 GridSearchCV 进行细致的超参数调优,并且做了特征工程——例如创建胆固醇比值(LDL/HDL ratio)和 BMI 分类变量。这些手工特征可能帮助 Stacking 元学习器捕获了单模型遗漏的信息。AI 在自动化流程中未能复现这些针对性的工程步骤。

F1 值详细对比

| 模型 | 原论文 F1(Table 1) | AI F1 |

|---|---|---|

| Stacking | 0.96 | 0.9267 |

| Gradient Boosting | 0.94 | 0.9241 |

| XGBoost | 0.93 | 0.9195 |

| Random Forest | 0.84 | 0.9085 |

| Extra Trees | 0.74 | 0.8169 |

F1 值的对比更有意思:在 Random Forest 和 Extra Trees 上,AI 大幅领先;但在 Stacking、Gradient Boosting 和 XGBoost 上,原论文的 F1 更高。这进一步印证了一个结论:AI 擅长把弱模型做强,但把强模型做到极致仍需研究者的专业调优。

SHAP 特征重要性:高度一致

| 排名 | 原论文(SHAP 分析部分) | AI 验证 | 一致性 |

|---|---|---|---|

| 1 | Functional Assessment | Functional Assessment | 一致 |

| 2 | ADL | ADL | 一致 |

| 3 | Memory Complaints | Memory Complaints | 一致 |

| 4 | MMSE | MMSE | 一致 |

| 5 | Behavioral Problems | Behavioral Problems | 一致 |

Top 5 预测因子完全吻合。功能评估和日常生活能力对阿尔茨海默病的预测贡献最大,这与临床实践中"功能退化是早期信号"的共识高度一致。记忆投诉和 MMSE 紧随其后,进一步佐证了认知-功能双维度筛查的价值。

原论文还报告了胆固醇(Total、LDL、HDL)、生活方式指标(AlcoholConsumption、PhysicalActivity、DietQuality、SleepQuality)以及 SystolicBP 和 Depression 的重要性——这些在 AI 的 SHAP 分析中同样得到了体现。

研究员 + AI 各自做擅长的事

| 研究员负责 | AI 负责 |

|---|---|

| 选择研究方向:阿尔茨海默病早期预测 | 数据清洗与预处理 |

| 设计特征工程:胆固醇比值、BMI 分类 | 5 种模型训练 + 交叉验证 |

| 精细调参:GridSearchCV 策略设计 | 生成 5 张可视化图表 |

| 解读 SHAP 结果的临床意义 | SHAP 全局特征重要性分析 |

| 撰写 Discussion:为何 FunctionalAssessment 最重要 | 7 分钟输出完整分析报告 |

研究员带来的是领域知识和优化直觉——知道该造什么特征、该往哪个方向调。AI 带来的是速度和标准化——7 分钟建立高质量 baseline,让研究者把时间花在真正需要思考的地方。

值不值?算一笔账

这次分析消耗了 305.69 积分,折合人民币 3.06 元——不到一杯奶茶钱。

手动完成同样的工作量——数据探索与预处理、5 种模型训练与评估、Stacking 集成构建、SHAP 全局分析、5 张可视化图表——一个熟练的研究生至少需要 3-5 天。这里 7 分钟。

统计分析外包市场价 3000-8000 元/次。这次总共花了 3.06 元。

当然,要达到原论文 97% 准确率的 Stacking 性能,还需要研究者自己做特征工程和超参数优化。但有了这个 94.88% 的 baseline,研究者的起点已经相当高了。

产出清单

| 类别 | 内容 |

|---|---|

| 可视化 | 混淆矩阵、模型对比图、ROC 曲线、SHAP summary bar、SHAP beeswarm |

| 模型 | Random Forest、XGBoost、Gradient Boosting、Extra Trees、Stacking |

| 分析 | 完整性能指标(Accuracy、AUC、Precision、Recall、F1)+ SHAP 特征排序 |

| 文件 | 共 30 个文件 |

数据来源:Kaggle Alzheimer's Disease Dataset,2149 名患者,36 个变量。

原始论文引用:Hossain MK, Ashraf A, Islam MM, Sourav SH, Shimul MMH. Optimizing Alzheimer's disease prediction through ensemble learning and feature interpretability with SHAP-based feature analysis. Alzheimers Dement (Amst). 2025;17(3):e70162. doi:10.1002/dad2.70162

方法差异说明:原论文使用了 GridSearchCV 超参数调优和特征工程(胆固醇比值、BMI 分类),AI 验证未完全复现这些步骤,这可能是 Stacking 性能差距的主要原因。AI 的单模型性能全面超越原论文,说明自动化流程在基础建模上已具备足够能力。

局限性:数据集为横断面数据,无法反映疾病进展;缺少神经影像和生物标志物数据;模型泛化能力有待外部数据集验证。